Ho già parlato dell’intelligenza artificiale di chatGPT, ora arrivata alla release GPT-4, e delle enormi potenzialità che offre ma anche chiudendo l’articolo domandandomi quali rischi tutto ciò comporterà. Le “paure” che ho espresso ora sono state esplicitate dalla pubblicazione di una lettera aperta online. L’importanza della lettera è data dallo spessore dei suoi firmatari, eccone alcuni:

- Elon Musk: CEO di SpaceX, Tesla e Twitter e tra i fondatori di OpenAI che ha sviluppato proprio di chatGPT.

- Yoshua Bengio: fondatore e direttore scientifico di Mila, l’istituto canadese che in collaborazione con IBM ha sviluppato modelli di intelligenza artificiale e apprendimento automatico sfruttando il deep learning.

- Stuart Russell: docente ordinario di informatica a Berkeley e direttore del Center for Human-Compatible Artificial Intelligence. Inoltre è coautore del libro “Artificial Intelligence: a Modern Approach”, diventato il testo standard in oltre 1.500 università in 135 paesi.

- Steve Wozniak: cofondatore di Apple.

Mi fermo qui anche se la lista è molto lunga e formata da accademici ed esperti di rilevanza mondiale. Nella lettera si chiede una pausa nell’addestramento di sistemi di AI più potenti di GPT-4 per almeno 6 mesi, durante la quale i laboratori di AI e gli esperti indipendenti dovrebbero sviluppare protocolli di sicurezza condivisi rigorosamente, verificati e supervisionati da esperti esterni indipendenti. Inoltre, gli sviluppatori di AI dovrebbero collaborare con i responsabili politici per accelerare il processo di sviluppo di solidi sistemi di governance dell’intelligenza artificiale.

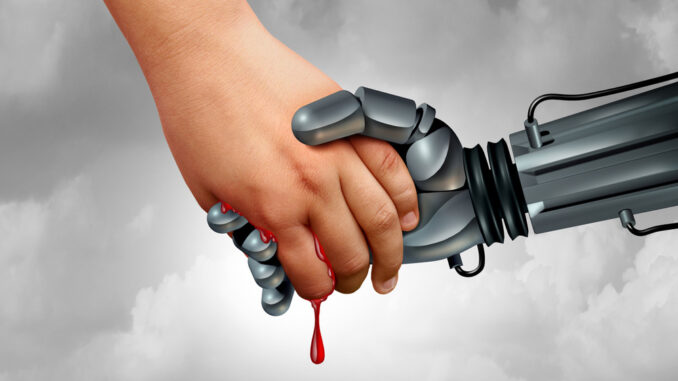

Le preoccupazioni derivano dal fatto che un’intelligenza artificiale avanzata potrebbe rappresentare un profondo cambiamento nella storia della vita sulla Terra e dovrebbe essere pianificata e gestita con cure e risorse adeguate ma sfortunatamente questo livello di pianificazione e gestione non sta avvenendo. Con tono allarmante nella lettera ci si domanda:

“I sistemi di intelligenza artificiale contemporanei stanno ora diventando competitivi per l’uomo in compiti generali, dovremmo lasciare che le macchine inondino i nostri canali di informazione con propaganda e falsità? Dovremmo automatizzare tutti i lavori, compresi quelli soddisfacenti? Dovremmo sviluppare menti non umane che alla fine potrebbero essere più numerose, superate in astuzia, obsolete e sostituirci? Dovremmo rischiare di perdere il controllo della nostra civiltà? Tali decisioni non devono essere delegate a leader tecnologici non eletti. Potenti sistemi di intelligenza artificiale dovrebbero essere sviluppati solo quando saremo certi che i loro effetti saranno positivi e i loro rischi saranno gestibili.”

Sono frasi e parole pesanti che fanno ancor più riflettere visto che le hanno condivise proprio i creatori dell’intelligenza artificiale. Qualcuno le ascolterà? Con questo dilemma mi fermo. Per adesso, ma solo per adesso è tutto, vi do appuntamento al prossimo articolo.

Davide Gambacciani

Leave a Reply